Stelsels van differentiaalvergelijkingen: Lineaire stelsels van differentiaalvergelijkingen

Reflectie op de oplossingsmethode

Reflectie op de oplossingsmethode

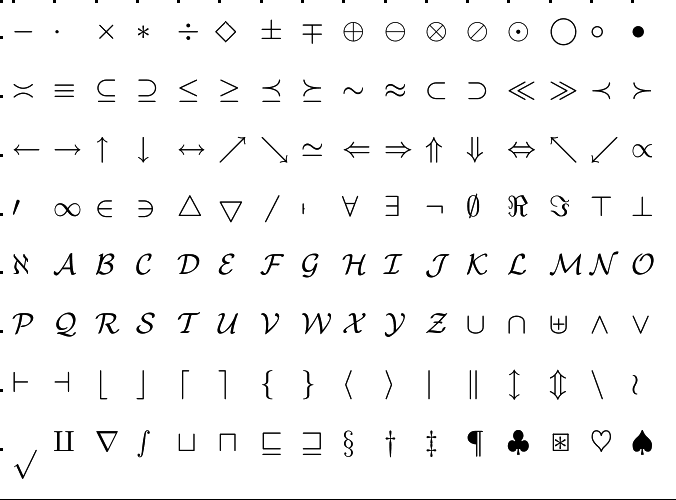

De differentiaalvergelijking van exponentiële groei \[\frac{\dd y}{\dd t}=r\cdot y\] heeft als oplossing \[y(t)=C\cdot e^{r\cdot t}\] met een constante \(C\). De exponentiële functie kunnen we als machtreeks opschrijven: \[e^{x}=1+x+\frac{1}{2!}x^2+\frac{1}{3!}x^3+\cdots=\sum_{k=0}^{\infty}\frac{1}{k!}x^k\]

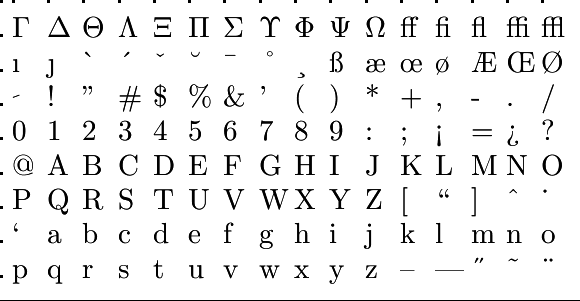

We kijken opnieuw naar een tweetal gekoppelde homogene lineaire eerste-orde differentiaalvergelijkingen met constante coëfficiënten van de vorm \[\left\{\begin{aligned} \frac{\dd x}{\dd t} &= a\, x+ b\, y\\[0.25cm] \frac{\dd y}{\dd t} &= c\, x + d\, y\end{aligned}\right.\] en schrijven dit in de matrix-vector vorm \[\frac{\dd}{\dd t}\cv{x\\y}=\matrix{a & b\\ c & d}\cv{x\\y }\] Noem de matrix \[A=\matrix{a & b\\ c & d}\] Er staat dus een vergelijking van de vorm \[\frac{\dd}{\dd t}\vec{v}=A\vec{v}\] De verleiding is groot om nu de oplossing op te schrijven als \[\vec{v}=e^{tA}\vec{C}\] met een zekere vector \(\vec{C}\) van constanten. Maar wat is dan bedoeld met de exponentiële functie toegepast op een matrix en hoe reken je die uit?

Het antwoord op de eerste vraag komt door de reeksontwikkeling van de exponentiële functie:

Definitie van exp(A) Voor een vierkante matrix \(A\) kunnen we \(\exp(A)=e^A\) definiëren als \[e^A=I+\sum_{k=1}^{\infty}\frac{1}{k!}A^k\]

Berekening van exp(A) Voor de berekening van \(e^A\) bekijken we eerst maar eens het geval dat \(A\) een \(2\times 2\) diagonaalmatrix is, zeg \(A=\matrix{\lambda_1 & 0\\ 0 & \lambda_2}\). Dan \[\begin{aligned}e^A &=I + \sum_{k=1}^{\infty}\frac{1}{k!}\matrix{\lambda_1 & 0\\ 0 & \lambda_2}^k\\ \\ &= I + \sum_{k=1}^{\infty}\frac{1}{k!}\matrix{\lambda_1^k & 0\\ 0 & \lambda_2^k} \\ \\ &= \matrix{\sum_{k=0}^{\infty}\frac{1}{k!}\lambda_1^k & 0\\ 0 & \sum_{k=0}^{\infty}\frac{1}{k!}\lambda_1^k } \\ \\ &= \matrix{e^{\lambda_1} & 0\\ 0 & e^{\lambda_2}}\end{aligned} \] Als \(A\) door een transformatie \(T\) op diagonaalvorm \(\Lambda\) is te brengen, zeg \(T^{-1}AT=\Lambda\), dan kun je gebruiken dat \( (T^{-1}AT)^k = T^{-1}A^k T\) en zie je in dat: \[T^{-1}e^AT=e^{T^{-1}e^AT}=e^{\Lambda}\] Dan geldt dus: \[e^A=Te^{\Lambda}T^{-1}\] Uit de lineaire algebra weten we al hoe we \(T\) moeten bepalen als er twee verschillende eigenwaarden zijn of als er maar één eigenwaarde met een 2-dimensionale eigenruimte is: schrijf de eigenvectoren als kolommen in de matrix \(T\) op. Op het geval van één eigenwaarde met een 1-dimensionale eigenruimte gaan we niet in, maar ook dit is redelijk te doen.